hesst schrieb:

damit kennst du den datentyp, in dem du die werte speicherst.

Ja

ich kenne den Datentyp meines Empfängers,

aber ich kenne nicht den Datentyp und/oder die Auflösung von andren Empfängern

hesst schrieb:

es geht auch nicht, dort musst du auch das format angeben in dem die daten vorliegenl

Hab ich mir doch gedacht, dann muss ich eine Client Software programmieren, die zumeidest im usb-sdr oder Soundkartenfall 16 bit liefert, baut derjenige dem Empfänger selber muss er es mir mitteilen.

Ich muss dann halt Servesseitig für jedes erdenkliche Format einen Konverter Programmieren.

hesst schrieb:

mit server meinst du den atmega?

Ne der Atemga ist ein Teil der Hardware des Zulieferers. Mein Server ist auf einen Hoster (vServer) hochgeladen und verrichtet da seine arbeit.

Der Version mit den atmaga machen nur wenige Funkamateure, die meisten werden entweder via USB oder über Soundkarte gehen.

Das Ziele meines Nodejs Skriptes(liegt auf dem vserver)ist ein Bindeglied zwischen Hardware und internt zu schaffen. Das Problem ist das man für ein normal CW bild alle 30sec ein ftp Verbindung öffne muss,dann kappt das nicht immer jedes 2te bild wird übersprungen.

Zusätzlich werden via dropbox noch 12h an Bildern gepeichert als Archiv so zu sagen, ist auch wieder Bandbreite.

Das 2te Problem ist es gibt uneidlich viel Hardware und dann natürlich auch Treiber+Betriebssysteme, die Software für die für die fft verwendet wird ist reinweg Windows basierend, fällt also fürs Raspberry Pi schon mal flach.

Ein weiters Problem ist das ein Windows Rechner strom verbraucht und das 24h rund um die uhr, das Raspberry Pi nur rund 3 watt, ein weiters Thema ist das viel Funkamateure auf ihren Recher kein Webserver like Apache laufen lassen wollen (es könnte mich ja jemand hacken).

Ich habe mir halt gedacht, wie könnte man sich das oder die Problem(e) angehen und bin halt auf die Idee gekommen ein TCP to websocket Bridge zu programmieren, die auf ein hoster liegt, das Rendern der fft funktioniert in Browser. Für normal cw ganz gut aber für qrss 20 nicht, das Rendern geht so langsam das man den Browser 12h anlassen muss ehe der Wasserfall eine Millimeter weiter gerückt ist. Drauf hin ist die Tcp to websockt bridge um ein paar Funktionen erweitert worden. Auf den Server werden nicht nur dir Protokolle geändert sonder auch noch eine fft gemacht und die Bilder für die Langsameren modie vorgerendert.

hesst schrieb:

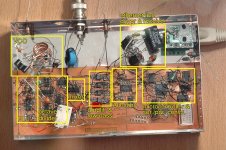

alter, ist die von dir? ne doppelseitige platine kostet inkl. vias kaum mehr als ne einseitige, oder ätzt du die selber?

ne das ist nicht von mir, das ist ein Bild von einen Holländer aber unser Empfänger ist derselbe, ist aber noch nicht fertig.

Das ätzen lassen

wir machen, dafür bin ich Funkamateur man kennt da mehr Leute als ein manch mal lieb ist.

Den Schaltplan zeichne ich selber

Habe aber schon andere Sachen gemacht, z.b. habe ich ein Usb-stick DVB-T Hama NANO geöffnet und den Tuner überbrück, gelötet habe ich unter einem Mikroskop, das ist kein scheiß.

Den draht den ich dafür benötigt habe, habe ich von einer Hochfrequenz spule abgewickelt, ein einzelnes Litze von einem Kabel war zu dick.